Il file robots.txt è un documento di testo di facile utilizzo che ha lo scopo di dare ai motori di ricerca delle informazioni sullo stato di una pagina, su un’area ristretta o sull’intero dominio. Per tale motivo in questo articolo ti spiegherò a cosa serve il file robots.txt, come installarlo, quali comandi utilizzare e perchè potrebbe incididere sulla mancata indicizzazione nei motori di ricerca.

A cosa serve il file robots.txt e come installarlo

Nei giorni scorsi ho introdotto ed approfondito alcuni strumenti di Google come ad esempio Google Webmaster e Google Analytics; in entrambi i casi era chiaro come questi due strumenti fossero importanti ai fini di un’ottimizzazione e successivamente del posizionamento sui motori di ricerca.

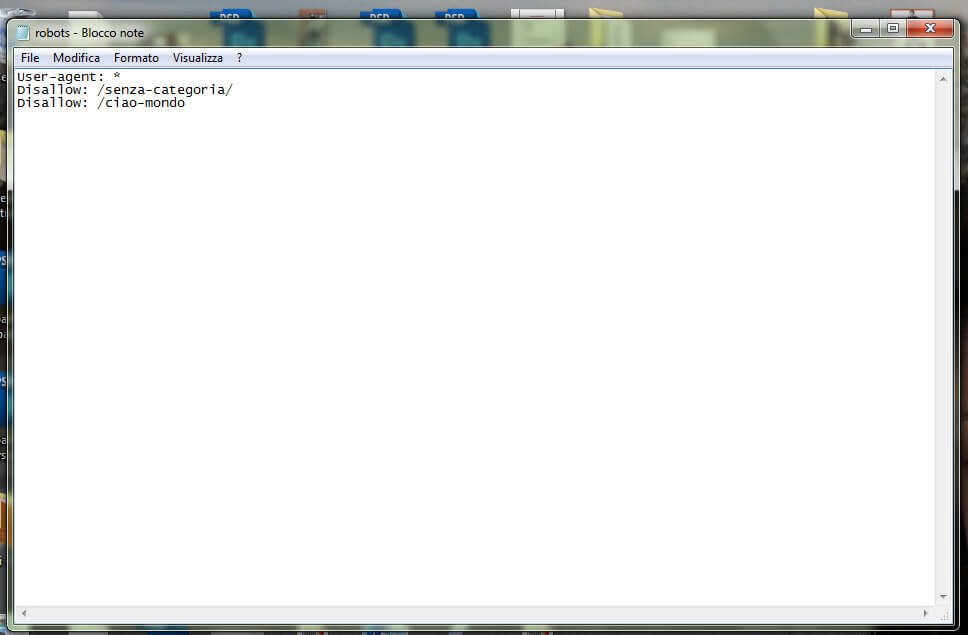

Il file robots.txt, come ho accennato fin dalle prime righe, è un semplice file di testo con estensione .txt, cioè uno di quei documenti che puoi creare su una qualunque versione di Windows tramite il “Blocco note”. Questo file però è fondamentale per l’indicizzazione sui motori di ricerca, perché basta sbagliare un comando e tutto il tuo lavoro verrà oscurato.

Il file nega agli spider l’accesso ad una singola pagina, ad un’area in particolare o ad un intero sito web. Per tale motivo il file robots.txt deve essere utilizzato solo da persone che ne sono capaci di comprendere i suoi comandi e quindi il suo utilizzo.

Come creare il file robots

- Per iniziare devi creare un nuovo documento. Se hai Windows puoi cliccare sul desktop > Nuovo > Documento di testo;

- Rinomina il file in questo modo “robots”. Non è necessario aggiungere l’estensione .txt perché lo farà in automatico;

- Scrivere i comandi User-agent e Disallow;

- Tramite il client FTP (ad esempio Filezilla) o direttamente dal pannello di controllo dell’hosting in cui hai acquistato lo spazio web, carica il file all’interno della root principale, in modo tale da ottenere un indirizzo web di questo genere: http://www.nomesito.com/robots.txt ;

- A questo punto il tuo file è pronto.

Campi da utilizzare nei record del file robots.txt

Dopo aver capito a cosa serve il file robots.txt, come crearlo e dove caricarlo, ti elencherò i comandi o i campi che è possibile utilizzare all’interno del file:

- User-agent: questo campo si riferisce al nome dello spider a cui verrà chiesto di bloccare (con il comando Disallow) od abilitare (con il comando Allow) alcune parti del sito web.Per bloccare tutti gli spider senza alcuna eccezione utilizzi il carattere * (asterisco), in questo modo:User-agent: *

È comunque possibile disabilitare l’accesso ad uno specifico robot riportando il suo nome esatto: nel caso del motore di ricerca di Google dovrai scrivere googlebot. - Disallow: con Disallow neghi ad uno spider di navigare in una specifica pagina, ad un’intera directory o, ancora più eccessivo, all’intero dominio.Alcuni esempi:

Disallow: http://www.nomesito.com/pagina.html

Disallow: /nomedirectory/

Disallow: /Nel primo esempio abbiamo bloccato l’accesso al file pagina.html, nel secondo caso abbiamo bloccato l’intera directory “nomedirectory” e nel terzo esempio abbiamo negato l’accesso all’intero sito web. - Allow: come è possibile intuire, Allow è il contrario del comando Disallow. Viene utilizzato solo nel caso in cui hai già vietato la scansione di una directory o dell’intero sito tramite il comando Disallow e vuoi escludere una singola pagina.Per esempio hai bloccato l’intera directory “frutta” e vuoi però far scansionare la pagina “mela.html”:User-agent: *

Disallow: /frutta/

Allow: http://www.nomesito.com/frutta/mela.html

A cosa serve il file robots.txt e perché non viene utilizzato da molti

Questo file è vero che è di semplice utilizzo, ma è anche vero che può indurre molto facilmente allo sbaglio, compromettendo l’indicizzazione ed il posizionamento su Google. Questo è uno dei motivi principali per cui il proprietario di un sito web, piuttosto che un webmaster, decide di non utilizzarlo.

A cosa serve il file robots.txt e quando è necessario usarlo

In molti si sono chiesti a cosa serve il file robots.txt veramente e perché si ha la necessità di utilizzarlo. La risposta è che questo file è importante se vuoi bloccare la scansione di una parte del sito. Se per esempio hai un articolo che non vuoi che venga indicizzato da Google, o dai search engine in generale, con il comando Disallow puoi bloccare la sua indicizzazione. Questo non significa che il file non sarà reperibile e navigabile da un utente, significa soltanto che non apparirà mai tra i risultati delle ricerche.

Se dovessi avere la necessità di bloccare l’accesso ad una pagina od una directory, non soltanto ai robot ma anche agli utenti, puoi vietare l’accesso tramite password. Per esempio chi utilizza WordPress può decidere di far visualizzare il contenuto solamente agli utenti in possesso della password.

Con la maggior parte dei servizi hosting puoi anche bloccare una pagina o una directory con password direttamente dal pannello di controllo.

Per maggiori dettagli sul suo utilizzo puoi leggere le linee guida di Google scritte in merito all’argomento.

Perché il mio sito non è visibile su Google

Migliaia di utenti si sono chiesti perchè il loro sito non era più visibile nei risultati di Google. La risposta potrebbe variare di caso in caso, ma è sicuramente importante verificare che l’intero dominio non sia bloccato dal file robots.txt tramite questi record:

Userg-agent: *

Disallow: /

Con questo uniche due righe stai bloccando l’accesso dell’intero sito agli spider (compreso quello di Google, nonchè il più importante).

Se hai erroneamente bloccato l’accesso ad una parte del sito o all’intero sito, non preoccuparti, puoi sempre rimediare eliminando i comandi del file robots.txt che non ti interessano.

Il file robots.txt e Google Webmaster

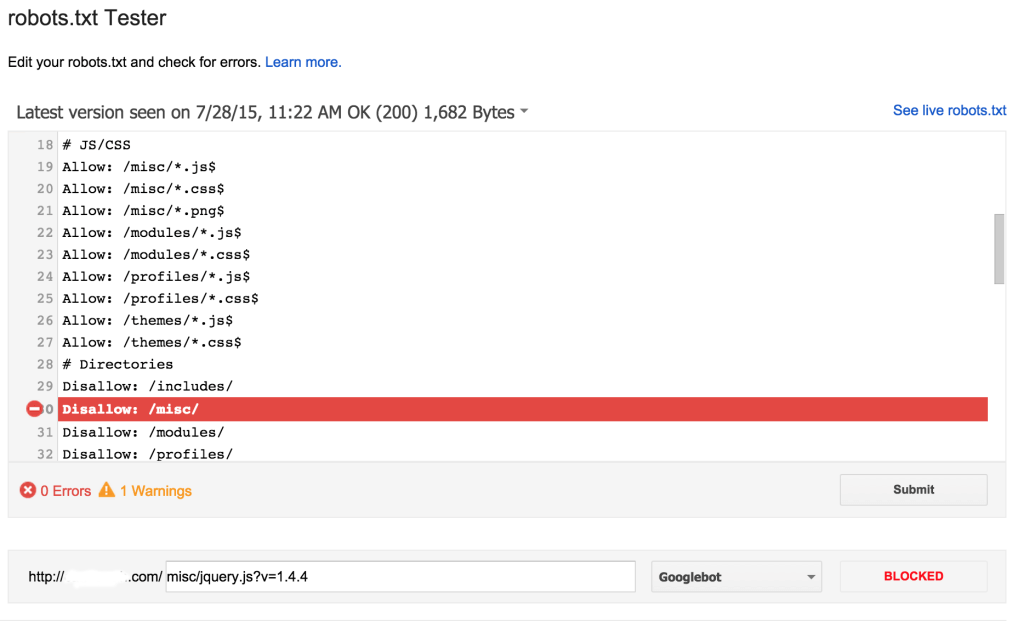

Con Google Webmaster, ovvero la Search Console di Google, puoi testare il file robots.txt dei tuoi siti web e controllare la presenza di eventuali errori.

Entrando su Google Webmaster > Scansione > Tester dei file robots.txt, scorrendo la pagina in basso troverai un campo dove inserire l’indirizzo URL che vuoi testare. In questo modo verificherai se quella pagina, quell’area o l’intero sito è bloccato oppure no.

Come è possibile identificare una sitemap tramite il file robots

Aggiungere la sitemap nel file robots.txt non è necessario, ma è possibile. Solitamente la sitemap.xml va creata e poi segnalata tramite la Search Console di Google e questo può bastare. Alcune persone preferiscono aggiungerla nel file robots perché quest’ultimo è il primo file che viene scansionato dai motori di ricerca e quindi sarebbe la prima cosa cosa che i motori di ricerca scansionerebbero. Aggiungere la sitemap nel file robots.txt è un passaggio ulteriore, ma sicuramente non è indispensabile e per tanto può essere tralasciato.

Il comando per questo campo è “Sitemap: http://www.nomesito.com/sitemap.xml”.

AdCrescendo.com

AdCrescendo.com